이 글에서는 EXAONE 4.5를 중심으로, 해당 모델이 어떤 배경에서 등장했으며 어떤 기술적 특징과 강점을 갖는지 정리합니다. 기존 EXAONE 4.0 언어 모델에 시각 인코더를 통합해 멀티모달로 확장된 구조, 대규모 파라미터 설계, 주요 벤치마크 성능, 그리고 실제로 어떻게 서버에 올리고 활용할 수 있는지까지 한 번에 이해할 수 있도록 설명합니다. 멀티모달 AI 모델을 직접 다뤄보고자 하는 개발자나 연구자라면 전체 흐름을 파악하는 데 도움이 될 것입니다.

EXAONE 4.5 개요와 등장 배경

EXAONE 4.5는 LG AI Research가 공개한 첫 오픈 웨이트 비전-언어 모델입니다. 기존 EXAONE 4.0 언어 모델 프레임워크에 전용 비전 인코더를 통합해, 텍스트와 이미지를 동시에 이해하고 추론할 수 있도록 확장한 것이 핵심 변화입니다.

이 모델은 단순한 멀티모달 실험 수준을 넘어, 대규모 언어 모델에서 축적한 한국어 이해력과 문서 추론 능력을 시각 정보 처리까지 자연스럽게 연결하는 데 초점을 맞추고 있습니다.

모델 구성과 아키텍처 특징

EXAONE 4.5는 총 330억 파라미터 규모의 Dense 모델입니다.

기본 구성

- 언어 모델 파라미터: 31.7B

- 비전 인코더 파라미터: 1.29B

- 모델 타입: Causal Language Model + Vision Encoder

핵심 구조적 특징

- 64개 메인 레이어와 1개 MTP 레이어 구성

- Sliding Window Attention과 Global Attention을 혼합한 하이브리드 어텐션 패턴

- 최대 262,144 토큰의 긴 컨텍스트 길이 지원

- 비전 인코더에 Grouped Query Attention과 2D RoPE 적용

이 설계 덕분에 장문 문서, 복잡한 이미지-텍스트 혼합 입력에서도 안정적인 추론이 가능하도록 구성돼 있습니다.

멀티모달 성능과 강점

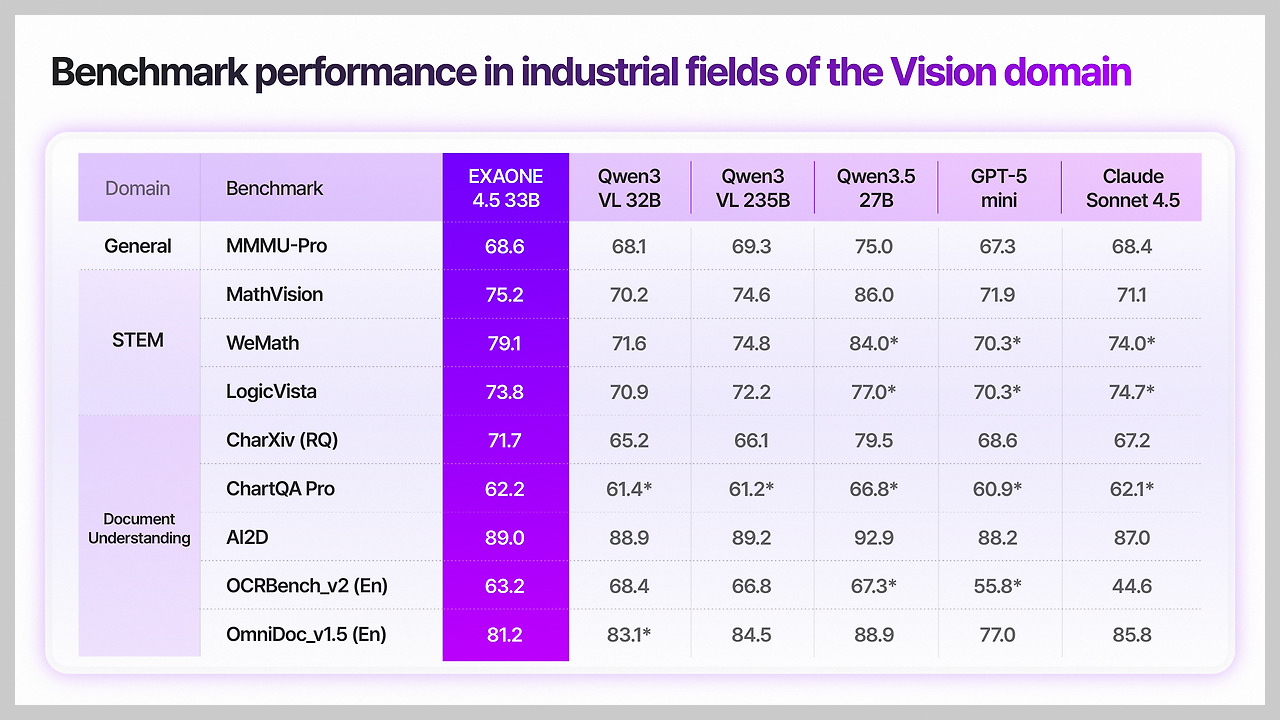

EXAONE 4.5는 일반적인 비전-언어 벤치마크에서 경쟁력 있는 성능을 보이며, 특히 다음 영역에서 강점이 두드러집니다.

문서 이해 및 OCR 계열

AI2D, OCRBench v2, OmniDocBench 등 문서 이해 중심 벤치마크에서 동급 파라미터 모델 대비 우수한 성능을 기록했습니다. 이는 긴 컨텍스트 처리 능력과 언어 이해력이 결합된 결과로 볼 수 있습니다.

한국어 추론 성능

KMMMU, K-Viscuit, KRETA 등 한국어 기반 벤치마크에서 안정적인 성능을 보여주며, 기존 EXAONE 언어 모델의 강점을 그대로 계승하고 있습니다.

범용 멀티모달 추론

수학, 퍼즐, 논리 문제를 이미지와 함께 다루는 태스크에서도 Reasoning 모드 기준으로 일관된 결과를 제공합니다.

EXAONE 4.5 서빙 환경과 배포 방식

EXAONE 4.5는 실제 서비스 환경을 고려해 여러 추론 엔진을 지원합니다.

지원 프레임워크

- TensorRT-LLM

- vLLM

- SGLang

- llama.cpp (확장 예정)

256K 컨텍스트 기준으로 단일 H200 GPU 또는 A100 40GB GPU 4장 구성에서도 서빙이 가능하도록 설계돼 있습니다.

간단한 사용 예시: OpenAI 호환 API

EXAONE 4.5는 OpenAI 호환 API 형태로 제공되기 때문에, 기존 OpenAI SDK를 그대로 활용할 수 있습니다.

이미지-텍스트 질의 예시

- Reasoning 모드에서는 정확성을 중시한 복합 추론에 적합

- Non-reasoning 모드에서는 응답 지연을 최소화한 빠른 결과 제공

또한 텍스트 전용 질의, 이미지 기반 QA, 에이전트형 활용까지 동일한 인터페이스로 확장할 수 있어 기존 파이프라인에 쉽게 통합할 수 있습니다.

모델 사용 시 권장 설정과 주의사항

- 일반 목적: temperature 1.0, top_p 0.95

- OCR·문서·한국어 입력: temperature 0.6, top_p 0.95

- 기본적으로 reasoning 모드가 활성화되어 있어 필요 시 비활성화 설정 필요

- 출력 포맷은 boxed 형식을 권장

멀티모달 모델 특성상 부정확하거나 편향된 응답이 발생할 수 있으며, 최신 정보가 반영되지 않을 수 있다는 점도 명시적으로 안내되고 있습니다.

EXAONE 4.5는 대규모 언어 모델의 강점을 유지하면서, 실질적인 멀티모달 활용을 가능하게 한 오픈 웨이트 모델이라는 점에서 의미가 큽니다. 긴 컨텍스트 처리, 문서 이해, 한국어 추론에 강점을 가진 구조는 실제 산업 환경이나 연구 프로젝트에서 바로 활용 가능한 수준을 보여줍니다.

앞으로 멀티모달 AI를 자체 인프라에서 직접 운영하고자 하는 조직이나, 한국어 중심의 비전-언어 모델을 찾는 개발자에게 EXAONE 4.5는 현실적인 선택지가 될 수 있을 것으로 기대됩니다.

https://huggingface.co/LGAI-EXAONE/EXAONE-4.5-33B

LGAI-EXAONE/EXAONE-4.5-33B · Hugging Face

We’re on a journey to advance and democratize artificial intelligence through open source and open science.

huggingface.co

'인공지능' 카테고리의 다른 글

| 로컬에서 작동하는 오픈소스 AI 동료, Rowboat 기술 개념과 활용 정리 (0) | 2026.04.10 |

|---|---|

| 자연어 한 줄로 전략을 실행하는 AI 트레이딩 에이전트, Vibe-Trading 정리 (0) | 2026.04.10 |

| MiniMax AI Platform 공식 CLI(mmx-cli)로 시작하는 멀티모달 AI 개발 환경 정리 (0) | 2026.04.10 |

| Google AI Research의 PaperOrchestra: 실험 로그만으로 완성되는 AI 연구 논문 자동 작성 프레임워크 (0) | 2026.04.10 |

| Google LangExtract와 OpenAI 모델로 구현하는 문서 인텔리전스 파이프라인 구축 가이드 (0) | 2026.04.10 |