최근 코드 관련 작업에서 대형 언어 모델(LLM)의 역할은 혁명적입니다. 오픈 소스 커뮤니티에서도 강력한 코드 LLM을 개발하려는 노력이 계속되고 있으며, 그 결과물 중 하나가 바로 OpenCoder입니다. OpenCoder는 완전한 오픈 소스 코드 LLM으로, 누구나 사용할 수 있고 그 개발 과정까지 투명하게 공개된 혁신적인 모델입니다. 이번 포스팅에서는 OpenCoder의 개념과 주요 특징을 살펴보고, 다른 모델들과 비교했을 때의 장점들을 알아보겠습니다.

OpenCoder란 무엇인가?

OpenCoder는 코드 생성 및 코드 이해를 위한 오픈 소스 대형 언어 모델(LLM)로, 코드 관련 연구와 개발을 위한 탄탄한 기반을 제공합니다. 영어와 중국어를 지원하며, 두 가지 크기의 모델(1.5B와 8B)을 포함하고 있습니다. OpenCoder는 완전히 투명한 데이터 처리 파이프라인과 재현 가능한 데이터셋을 바탕으로 개발되었습니다. 이 모델은 2.5조 개의 토큰을 학습했으며, 그 중 90%는 원시 코드, 10%는 코드 관련 웹 데이터로 구성되어 있습니다.

OpenCoder의 개발 과정은 오픈 소스 커뮤니티의 표준을 따르며, 모든 데이터 처리와 학습 과정이 투명하게 공개됩니다. 연구자들과 개발자들은 모델 가중치, 추론 코드, 데이터 처리 파이프라인 등 모든 자료를 활용해 자신만의 모델을 구축하고 혁신할 수 있습니다.

OpenCoder의 주요 특징

- 완전한 오픈 소스

- OpenCoder는 개발 과정 전반이 공개되어 있어, 모든 사람이 자유롭게 활용하고 기여할 수 있습니다. 모델 가중치, 학습 데이터, 데이터 처리 과정 모두 투명하게 제공되므로, 연구자들이 이를 바탕으로 다양한 실험을 시도할 수 있습니다.

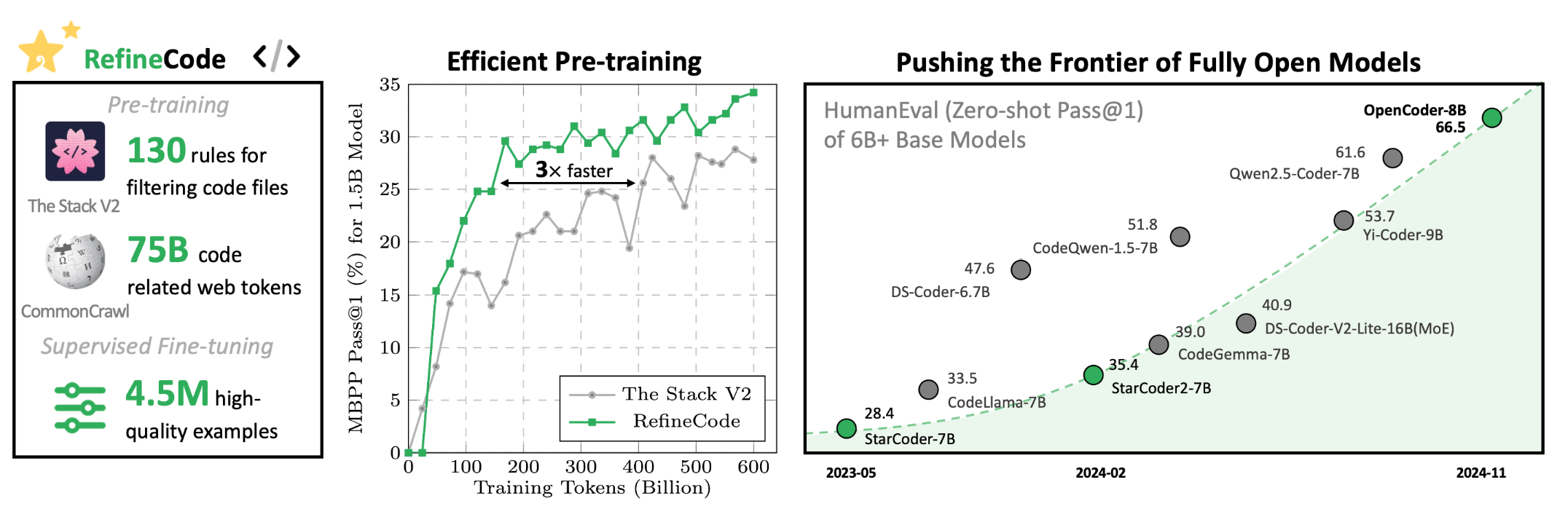

- RefineCode: 고품질의 사전 학습 데이터셋

- OpenCoder의 사전 학습 데이터셋인 RefineCode는 607개의 프로그래밍 언어에 걸쳐 9600억 개의 토큰으로 구성되어 있습니다. 이 데이터셋은 철저한 데이터 처리 과정을 통해 높은 품질을 유지하며, 코드 품질을 저해할 수 있는 불필요한 중복 데이터를 제거하였습니다.

- 투명한 데이터 처리 파이프라인

- 데이터 전처리, 중복 제거, 데이터 샘플링 등 데이터 처리의 모든 단계가 투명하게 공개됩니다. 이를 통해 개발자들은 코드 LLM을 학습시키는 과정을 명확히 이해하고, 자신들의 필요에 맞게 최적화된 학습 데이터를 만들 수 있습니다.

- 다양한 언어 지원

- OpenCoder는 영어뿐만 아니라 중국어까지 지원하며, 다양한 프로그래밍 언어를 포함한 데이터를 학습하여 다중 언어 환경에서도 뛰어난 성능을 발휘합니다.

- 이중 단계의 지시 조정(instruction tuning)

- OpenCoder는 일반적인 능력을 학습한 후, 코드와 관련된 구체적인 작업을 학습하는 이중 단계의 지시 조정 전략을 채택하여, 이론적 코드 문제부터 실무적 코딩 작업까지 탁월한 성능을 보입니다.

OpenCoder의 장점과 타 모델 대비 차별점

OpenCoder는 완전한 오픈 소스로, 다른 코드 LLM들과는 달리 모든 데이터와 학습 파이프라인이 공개되어 있습니다. 이는 연구자들이 OpenCoder를 바탕으로 더 깊이 있는 연구를 수행하고, 자신만의 LLM을 개발할 수 있는 기반을 제공합니다. 반면 다른 모델들, 예를 들어 CodeLlama나 Yi-Coder 등은 모델 가중치만 공개하고, 데이터 처리 과정이나 학습 데이터는 공개하지 않아 연구자들의 접근이 제한적입니다.

또한 RefineCode 데이터셋은 기존의 데이터셋 대비 품질이 뛰어나며, 코드의 다양성과 교육적 가치를 고려하여 철저하게 선별된 데이터로 구성되어 있습니다. OpenCoder는 이러한 데이터셋을 통해 사전 학습의 정확도와 효율성을 크게 향상시켰습니다.

OpenCoder의 이중 단계의 지시 조정 전략은 모델이 코드와 관련된 다양한 작업에 대해 더 나은 성능을 발휘할 수 있도록 해주며, 이로 인해 실질적인 코드 생성 및 이해 능력이 크게 향상됩니다.

결론

OpenCoder는 코드 LLM의 오픈 소스 커뮤니티에 새로운 가능성을 열어주고 있습니다. 연구자와 개발자들은 OpenCoder의 오픈된 데이터를 바탕으로 자신만의 실험과 혁신을 시도할 수 있으며, 이는 코드 인공지능 분야의 발전에 크게 기여할 것입니다. 완전한 투명성, 고품질의 데이터셋, 그리고 탁월한 성능을 갖춘 OpenCoder는 코드 AI 연구의 견고한 기반이 될 것입니다.

OpenCoder의 가능성에 대해 더 알아보고 싶다면, 오픈된 자료를 직접 확인하고 실험해보세요! 코드 인공지능의 미래를 함께 열어갈 수 있기를 기대합니다.

참고 링크 : https://arxiv.org/abs/2411.04905

'인공지능' 카테고리의 다른 글

| KubeAI: 쿠버네티스에서 프라이빗 AI를 손쉽게 운영하는 방법 (0) | 2024.11.15 |

|---|---|

| 프롬프트 체이닝이란 무엇일까? LLM과의 대화에서 숨겨진 가능성을 탐구해보자 (0) | 2024.11.13 |

| Kagi Translate: 기존 번역의 한계를 넘어 (0) | 2024.11.11 |

| DPO로 더 간편한 LLM 튜닝 – UNSLOTH를 활용한 구현 가이드 (0) | 2024.11.11 |

| 반복의 힘: RAG 시스템의 Loop 패턴과 인간 사고의 유사성 (0) | 2024.11.08 |