이 글은 Google의 최신 대형 언어 모델 Gemma 4를 Unsloth 환경에서 파인튜닝하는 방법과 그 과정에서 알아야 할 핵심 특징, 주의사항, 그리고 실제 학습 흐름을 정리한 IT 기술 블로그입니다.

Gemma 4의 모델 구성, VRAM 요구사항, 버그 이슈, LoRA/QLoRA 기반 파인튜닝 전략, Unsloth Studio와 코드 기반 학습 방법까지 한 번에 이해할 수 있도록 정리했습니다.

Gemma 4와 Unsloth 개요

Gemma 4는 Google이 공개한 차세대 멀티모달 모델로, 텍스트뿐 아니라 이미지와 오디오까지 처리할 수 있는 것이 가장 큰 특징입니다.

Unsloth는 이러한 Gemma 4를 더 빠르고, 더 적은 VRAM으로 학습할 수 있도록 최적화한 파인튜닝 프레임워크입니다.

Unsloth를 활용하면 다음과 같은 이점을 얻을 수 있습니다.

- 기존 Flash Attention 2 기반 환경 대비 약 1.5배 빠른 학습 속도

- 최대 60%까지 VRAM 사용량 절감

- Gemma 4 학습 시 발생하던 여러 구조적 버그 사전 해결

- 로컬 환경과 Colab 환경 모두에서 손쉬운 실행

Gemma 4 모델 라인업과 VRAM 요구사항

Gemma 4는 크기와 구조에 따라 여러 모델로 제공됩니다.

- E2B:

- 최소 8GB VRAM에서 학습 가능

- 경량 모델로 테스트 및 실험에 적합

- E4B:

- 10GB 이상 VRAM 필요

- 멀티모달 학습에 적합, 실사용 추천

- 26B-A4B (MoE):

- A100 GPU 권장

- 성능과 속도의 균형형

- 31B:

- 최고 성능 모델

- 고사양 환경 전용

LoRA 및 QLoRA 기준으로 보면,

E4B QLoRA가 정확도 대비 메모리 효율이 뛰어나 가장 추천되는 선택지입니다.

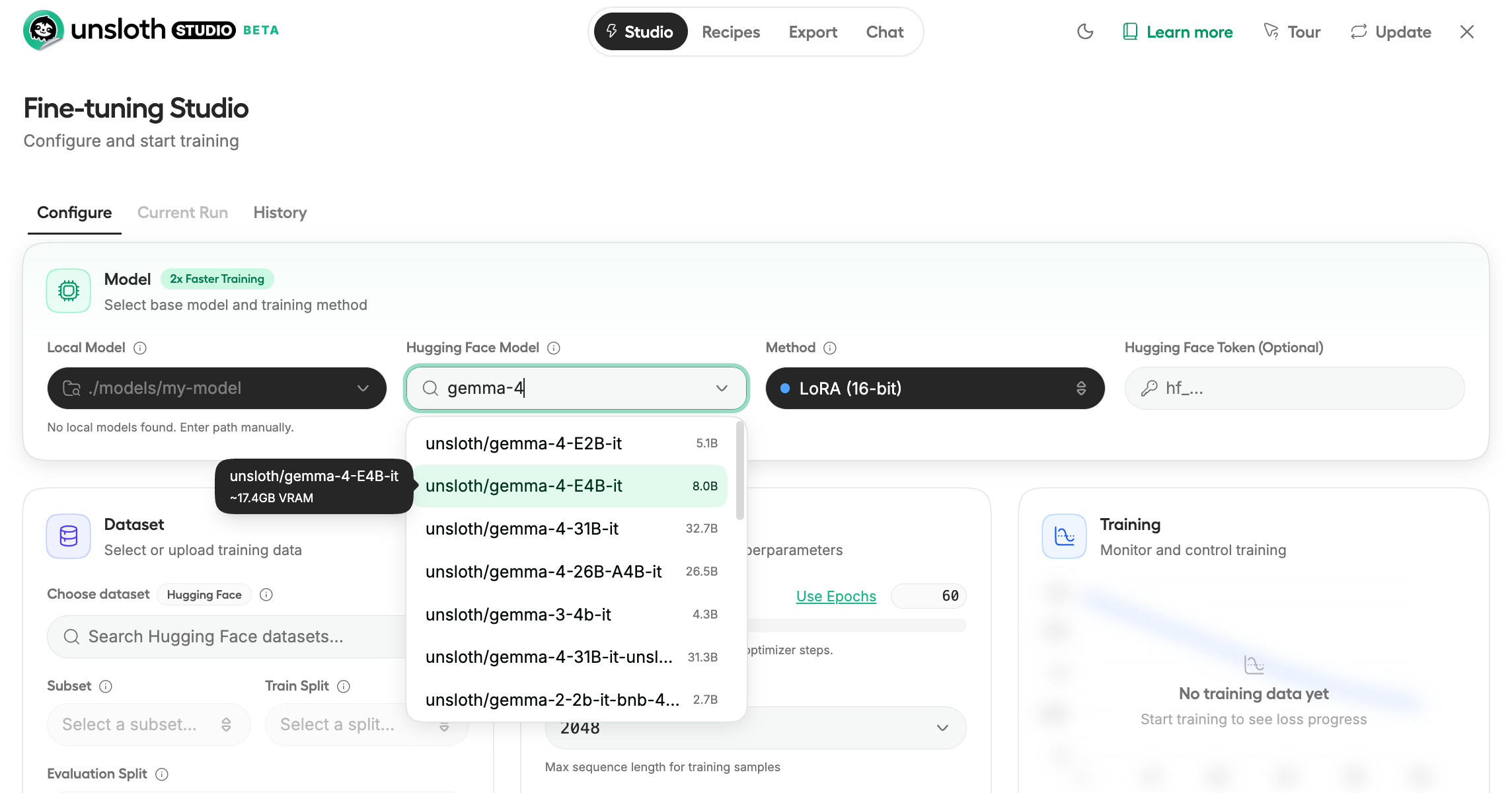

Unsloth Studio로 시작하는 빠른 학습

Unsloth는 코드 없이도 학습할 수 있는 Unsloth Studio라는 웹 UI를 제공합니다.

설치 방법

- macOS / Linux / WSL

curl -fsSL https://unsloth.ai/install.sh | sh

- Windows PowerShell

irm https://unsloth.ai/install.ps1 | iex

설치 후 아래 명령어로 Studio를 실행합니다.

unsloth studio -H 0.0.0.0 -p 8888

브라우저에서 http://localhost:8888에 접속하면 모델 선택, 데이터셋 설정, 하이퍼파라미터 조정까지 UI로 바로 진행할 수 있습니다.

Gemma 4 파인튜닝 시 반드시 알아야 할 특징과 버그 이슈

손실 값이 높게 보이는 문제

Gemma 4 E2B, E4B 모델은 학습 초반 loss 값이 13~15 수준으로 나오는 것이 정상입니다.

이는 멀티모달 모델에서 흔히 발생하는 현상으로, 학습 실패가 아닙니다.

Gradient Accumulation 이슈

Loss 값이 100 이상으로 튀는 경우는 대부분 gradient accumulation 설정 오류 때문이며,

Unsloth에서는 해당 문제를 내부적으로 수정했습니다.

use_cache=False 문제

기존 튜토리얼에서 자주 사용하는 use_cache=False 설정은

Gemma 4의 KV 공유 구조와 충돌하여 출력 품질이 붕괴되는 문제가 있었습니다.

Unsloth에서는 이 문제를 수정하여,

- use_cache=True / False 모두 동일한 출력 품질 보장

- 학습 손실 발산 문제 해결

Thinking Mode와 Chat Template 사용 전략

Gemma 4는 thinking 모드를 명시적으로 제어할 수 있습니다.

- 소형 모델(E2B, E4B): thinking 비활성화 추천

- 대형 모델(26B, 31B): thinking 모드 활성화 추천

토크나이저 설정 시 다음과 같이 선택합니다.

- 일반 대화: gemma-4

- 사고 과정 포함: gemma-4-thinking

파인튜닝 시에는 사고 과정을 학습할지, 최종 답변만 학습할지 명확히 결정해야 하며,

서로 다른 포맷을 섞는 것은 피해야 합니다.

코드 기반 Gemma 4 파인튜닝 흐름 요약

Unsloth Core를 사용하면 Python 코드로 세밀한 제어가 가능합니다.

기본 흐름은 다음과 같습니다.

- FastModel 또는 FastVisionModel로 Gemma 4 로드

- LoRA 또는 QLoRA 어댑터 추가

- Gemma 4 전용 chat template 적용

- 데이터셋 포맷 정규화

- SFTTrainer로 학습 수행

- GGUF, safetensors 등으로 모델 export

텍스트, 비전, 오디오 모두 동일한 구조를 기반으로 확장 가능합니다.

모델 저장 및 배포

학습이 끝난 모델은 다음과 같은 방식으로 활용할 수 있습니다.

- GGUF 포맷으로 저장하여 llama.cpp, Ollama, Unsloth 런타임에서 실행

- Hugging Face Hub로 바로 업로드

- 로컬 추론 서버 또는 vLLM 기반 배포

주의할 점은 학습에 사용한 chat template과 추론 시 template을 반드시 일치시켜야 한다는 것입니다.

Gemma 4와 Unsloth의 조합은 다음과 같은 의미를 가집니다.

- 고성능 멀티모달 모델을 개인 개발자도 현실적인 환경에서 파인튜닝 가능

- VRAM 제약으로 어려웠던 대형 모델 실험의 진입장벽 대폭 감소

- UI 기반과 코드 기반을 모두 지원해 활용 범위가 넓음

- 버그와 구조적 이슈가 정리되어 안정적인 학습 파이프라인 구축 가능

앞으로 Gemma 4는 멀티언어, 멀티모달 파인튜닝의 표준 선택지 중 하나로 자리 잡을 가능성이 높습니다.

특히 커스텀 AI 서비스, 도메인 특화 모델을 고민하고 있다면 Unsloth 기반 Gemma 4 파인튜닝은 충분히 검토해볼 만한 선택입니다.

Gemma 4 Fine-tuning Guide | Unsloth Documentation

Train Gemma 4 by Google with Unsloth.

unsloth.ai

'인공지능' 카테고리의 다른 글

| LM Studio Headless CLI와 Claude Code로 로컬에서 Google Gemma 4 실행하는 방법과 의미 (0) | 2026.04.08 |

|---|---|

| LLM 토큰 사용량을 60~90% 줄이는 고성능 CLI 프록시, RTK 정리 (0) | 2026.04.08 |

| QMD(Query Markup Documents): 로컬 환경에서 구현하는 하이브리드 문서 검색 엔진 (0) | 2026.04.08 |

| AI 코딩 에이전트 시대, CI/CD 파이프라인이 무너지는 이유와 해결 방법 (0) | 2026.04.06 |

| Claude Code 기반 Rails 업그레이드 방법론과 오픈소스 Skill 구조 정리 (0) | 2026.04.06 |