알리바바의 Qwen AI 팀이 공개한 Qwen3.5-Medium 시리즈는 오픈소스 기반으로 제공되면서도 최신 상용 모델과 견줄 수 있는 성능을 보여주는 대형 언어모델(LLM)입니다. 특히 로컬 GPU 환경에서 100만 토큰 이상의 컨텍스트를 처리할 수 있고, 4비트 양자화 이후에도 정확도를 유지하는 점이 주목받고 있습니다.

이 글에서는 Qwen3.5-Medium의 개요, 기술 구조, 성능 특징, 가격 경쟁력, 그리고 기업 활용 측면에서 어떤 의미를 갖는지 정리합니다.

Qwen3.5-Medium 모델 개요

Qwen3.5 시리즈는 총 네 가지 모델로 구성됩니다.

- 공개 모델

- Qwen3.5-35B-A3B

- Qwen3.5-122B-A10B

- Qwen3.5-27B

- 독점 모델

- Qwen3.5-Flash (Alibaba Cloud Model Studio API 전용)

이 중 세 가지 모델은 Apache 2.0 오픈소스 라이선스로 공개되어 Hugging Face와 ModelScope에서 다운로드할 수 있습니다.

Qwen3.5-Flash는 상용 API 형태로 제공되며, 서구권 주요 모델 대비 운영 비용이 낮은 것이 특징입니다.

또한 Qwen3.5-Medium 시리즈는 에이전트 도구 호출(agentic tool calling)을 기본적으로 지원해, 단순 질의응답을 넘어 외부 도구와 연동하는 자율형 AI 에이전트 구현에 적합합니다.

성능과 기술 구조

1. 최신 상용 모델을 능가하는 벤치마크 성능

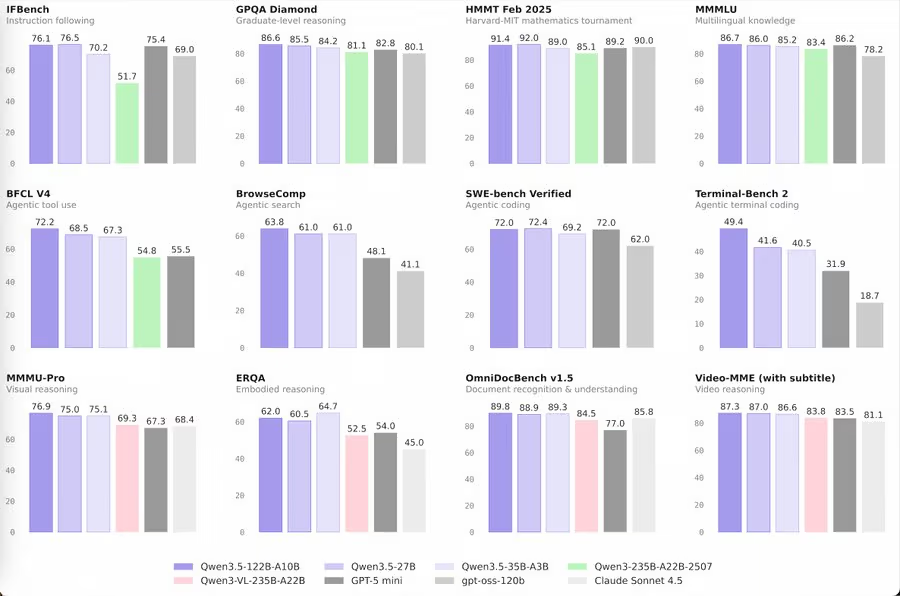

Qwen3.5 모델은 OpenAI GPT-5-mini와 Claude Sonnet 4.5 대비 벤치마크에서 우수한 결과를 기록했습니다.

특히 Qwen3.5-35B-A3B는 다음 항목에서 강점을 보입니다.

- 지식 평가(MMMLU)

- 시각 추론(MMMU-Pro)

이는 단순 텍스트 생성뿐 아니라 멀티모달 및 고급 추론 영역에서도 경쟁력이 있음을 보여줍니다.

2. 4비트 양자화와 100만 토큰 컨텍스트

Qwen3.5는 4비트 가중치 및 KV 캐시 양자화를 적용해 메모리 사용량을 대폭 줄였습니다.

그럼에도 정확도 손실이 거의 없다는 점이 핵심입니다.

- 로컬 GPU(32GB VRAM) 환경에서 실행 가능

- 100만 토큰 이상의 컨텍스트 윈도우 지원

- 대규모 문서, 로그, 코드베이스 분석 가능

일반적인 데스크톱 GPU에서도 대규모 데이터를 한 번에 처리할 수 있다는 점은, 기존 클라우드 중심 LLM 운영 구조에 큰 변화를 의미합니다.

3. 하이브리드 아키텍처: Gated Delta Networks + MoE

Qwen3.5는 다음 구조를 결합했습니다.

- Gated Delta Networks

- Sparse Mixture-of-Experts(MoE)

총 350억 파라미터 중 실제 활성화되는 파라미터는 약 3억 개에 불과합니다.

MoE 계층은 256개 전문가(8개 라우팅 + 1개 공유)로 구성되어, 필요한 부분만 선택적으로 활성화합니다.

이 구조 덕분에:

- 연산 효율성 향상

- 메모리 절감

- 로컬 배포 최적화

가 동시에 가능합니다.

모델별 특징 정리

Qwen3.5-27B

- 효율성 중심 설계

- 80만 토큰 이상 컨텍스트 지원

- 상대적으로 가벼운 환경에 적합

Qwen3.5-35B-A3B

- 연구 및 상용 활용 균형 모델

- Qwen3-235B 및 주요 상용 모델 대비 우수한 벤치마크 성능

Qwen3.5-122B-A10B

- 서버급 GPU(80GB VRAM) 대상

- 100만 토큰 이상 컨텍스트 지원

- 대규모 기업 환경에 적합

Qwen3.5-Flash

- 기본 100만 토큰 컨텍스트

- 공식 도구 내장

- 상용 API 전용, 저비용 구조

또한 연구 지원을 위해 Qwen3.5-35B-A3B-Base 모델도 함께 공개되었습니다.

Thinking Mode와 Tool Calling

Qwen3.5의 주요 기능 중 하나는 Thinking Mode입니다.

이 모드에서는 모델이 답변을 생성하기 전에 내부 추론 과정을 별도의 태그로 구성합니다. 이를 통해:

- 복잡한 문제 해결 정확도 향상

- 단계적 사고 기반 응답 생성

- 에이전트 로직 설계에 유리

또한 Tool Calling 기능을 통해:

- 웹 검색

- 코드 인터프리터

- 외부 API 호출

등을 자동화할 수 있습니다.

간단한 활용 예시를 들면:

- 사용자가 “최근 1년간 우리 회사 매출 트렌드를 분석해줘”라고 요청

- 모델이 내부적으로 Thinking Mode로 분석 전략 수립

- 재무 데이터 조회 도구 호출

- 분석 후 요약 리포트 생성

이와 같은 자율형 워크플로우 구성이 가능합니다.

가격 경쟁력과 API 비용

Qwen3.5-Flash API 요금은 다음과 같습니다.

- 입력: $0.1 / 100만 토큰

- 출력: $0.4 / 100만 토큰

- 캐시 생성: $0.125 / 100만 토큰

- 캐시 읽기: $0.01 / 100만 토큰

도구 호출 요금:

- Web Search: $10 / 1,000회

- Code Interpreter: 무료(한시적)

주요 모델과 비교했을 때 매우 저렴한 수준입니다.

- Claude Sonnet 4.5: 약 $18 / 100만 토큰

- GPT-5.2: 약 $15.75 / 100만 토큰

- Qwen3.5-Flash: 약 $0.5 / 100만 토큰

비용 측면에서 대규모 서비스에 적용할 때 차이는 매우 크게 나타날 수 있습니다.

기업 활용 측면에서의 의미

Qwen3.5-Medium 공개는 단순한 모델 출시 이상의 의미를 가집니다.

1. 온프레미스 AI 구축 가능

- 사내 방화벽 내 배포

- 데이터 외부 유출 방지

- 규제 산업에서도 적용 가능

특히 대용량 문서 및 영상 분석을 내부 인프라에서 처리할 수 있어 데이터 프라이버시와 주권을 강화할 수 있습니다.

2. 자율형 AI 에이전트 개발 기반

Thinking Mode + Tool Calling 조합은 다음을 가능하게 합니다.

- 사내 업무 자동화 에이전트

- 문서 분석 및 의사결정 지원 시스템

- 개발 보조 및 코드 생성 자동화

클라우드 의존 없이, 자체 AI 전략을 수립할 수 있는 기반이 마련된 것입니다.

3. 비용 절감과 운영 민첩성

- 저비용 API

- 로컬 실행 지원

- 4비트 양자화 기반 메모리 최적화

이는 AI 통합 과정에서 가장 큰 장벽인 비용과 인프라 부담을 크게 낮춥니다.

Qwen3.5-Medium 시리즈는 다음 세 가지 측면에서 의미가 큽니다.

- 성능: 최신 상용 모델과 경쟁 가능한 수준

- 효율성: 4비트 양자화 + MoE 구조로 로컬 실행 최적화

- 전략적 가치: 온프레미스 AI 및 자율형 에이전트 구축 가능

초기 사용자들의 평가처럼, 대형 폐쇄형 모델과의 격차를 빠르게 좁히고 있다는 점은 분명합니다.

앞으로 기업은 클라우드 기반 LLM에 전적으로 의존하지 않고도, 내부 인프라에서 고성능 AI를 운영할 수 있는 선택지를 갖게 되었습니다.

이는 단순한 기술 발전을 넘어, 비용 절감·보안 강화·운영 민첩성을 동시에 확보할 수 있는 전략적 전환점이 될 수 있습니다.

Alibaba's new open source Qwen3.5 Medium model offers near Sonnet 4.5 performance on local computers

This leap is made possible by near-lossless accuracy under 4-bit weight and KV cache quantization, allowing developers to process massive datasets without server-grade infrastructure.

venturebeat.com

'인공지능' 카테고리의 다른 글

| AI 이후의 데이터 엔지니어링: ETL을 넘어 ECL과 Context Architect로 (0) | 2026.03.03 |

|---|---|

| MCP는 죽었다? CLI가 다시 주목받는 이유와 실무에서의 선택 기준 (0) | 2026.03.03 |

| Claude Import Memory 기능 분석: 다른 LLM에서 개인화 맥락을 그대로 이전하는 방법 (0) | 2026.03.03 |

| 에이전틱 엔지니어링 시대, 개발자가 반드시 갖춰야 할 9가지 생존 스킬 (0) | 2026.03.03 |

| Claude Code 컨텍스트 소비 98% 절감, Context Mode MCP 서버로 세션 6배 확장하는 방법 (0) | 2026.03.03 |